Maîtriser le Crawl et l’Indexation : Le Guide Technique pour propulser votre SEO

Votre site web est peut-être invisible pour Google sans que vous le sachiez. Une mauvaise configuration technique peut masquer jusqu’à 40% de votre contenu aux yeux des moteurs de recherche. Le résultat ? Des positions perdues, un trafic organique qui stagne, des leads qui vont chez vos concurrents.

Chez Traffic Makers, notre analyse de centaines de sites depuis 2013 révèle une réalité : la majorité des entreprises négligent trois fichiers critiques qui contrôlent l’accès de Google à leur contenu. Ces fichiers — Sitemap XML, Robots.txt et .htaccess — ne sont pas des détails techniques réservés aux développeurs. Ce sont des leviers d’acquisition digitale qui impactent directement votre chiffre d’affaires.

Ce guide vous explique comment ces fichiers racines fonctionnent, pourquoi ils comptent pour votre visibilité, et comment les configurer correctement pour transformer votre référencement naturel en machine à générer des prospects qualifiés.

5 Signes que votre Configuration Technique Plombe votre Référencement Google

Avant d’entrer dans la technique, faites ce diagnostic rapide. Si vous reconnaissez au moins 2 de ces symptômes, votre site a un problème de configuration :

- •

1. Votre trafic organique stagne malgré la création régulière de contenu

Vous publiez des articles, des pages services, des fiches produits. Google Search Console montre des impressions, mais peu de clics. Votre contenu existe, mais Google ne le trouve pas ou ne le juge pas prioritaire. - •

2. Certaines pages mettent des semaines à être indexées

Vous créez une page stratégique. Elle n’apparaît dans Google qu’après 15 ou 30 jours. Pendant ce temps, vos concurrents captent les prospects. Une mauvaise gestion du sitemap et du budget de crawl ralentit votre indexation. - •

3. Votre site est lent, surtout sur mobile

Les pages mettent plus de 3 secondes à charger. Votre taux de rebond explose. Google pénalise les sites lents dans ses résultats de recherche. Le fichier .htaccess mal configuré amplifie ce problème. - •

4. Vous avez migré ou restructuré votre site et perdu des positions

Après une refonte, votre trafic a chuté de 20%, 30%, parfois 50%. Les anciennes URLs génèrent des erreurs 404. Les redirections 301 sont absentes ou mal paramétrées dans votre .htaccess. - •

5. Des pages internes inutiles apparaissent dans Google

Vos pages de panier, de connexion ou de recherche interne sont indexées. Google perd son temps à explorer des contenus sans valeur au lieu de se concentrer sur vos pages commerciales. Votre fichier Robots.txt ne bloque rien.

Vous vous reconnaissez ? Ces problèmes sont techniques, mais leur impact est commercial. Chaque jour de retard, c’est du trafic perdu et des leads qui ne se génèrent pas.

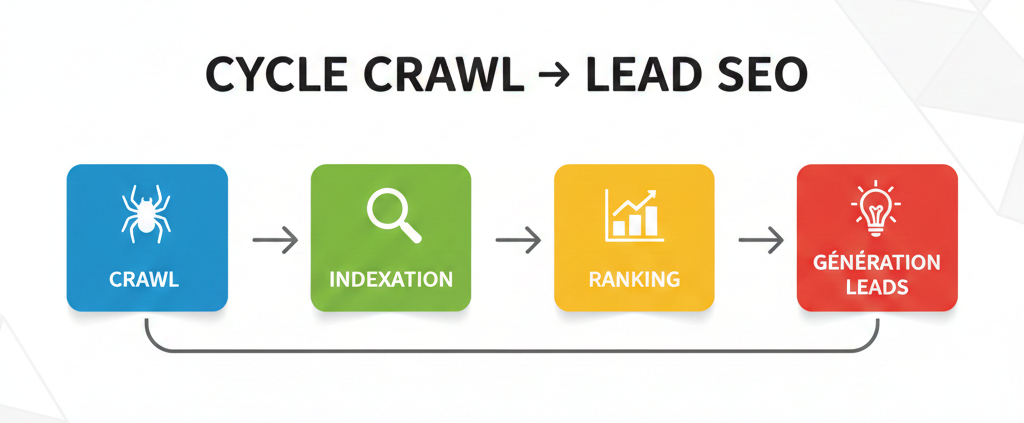

Comprendre le Cycle de Vie d’une Page : Du Crawl au Lead

Google ne découvre pas vos pages par hasard. Il suit un processus chronologique précis. Comprendre ce cycle vous permet de l’optimiser à chaque étape.

Étape 1 : Le Crawl (Exploration)

Google envoie des robots (appelés Googlebots) parcourir le web. Ces robots suivent les liens d’une page à l’autre. Le fichier Robots.txt est leur porte d’entrée : il leur indique où ils ont le droit d’aller et ce qu’ils doivent ignorer.

Métaphore simple : Imaginez Google comme un bibliothécaire qui vient archiver votre boutique. Le Robots.txt est le panneau à l’entrée qui dit « Réserve interdite, salle de stockage interdite, mais rayon principal accessible ». Si vous laissez le bibliothécaire perdre son temps dans la réserve, il n’aura plus d’énergie pour archiver vos meilleurs produits.

Étape 2 : Le Rendu (Traitement)

Une fois sur votre page, Google télécharge votre code HTML, vos fichiers CSS et JavaScript. Il reconstruit la page pour comprendre son contenu. C’est ici que le fichier .htaccess intervient : il contrôle la vitesse de livraison, active la compression des fichiers, gère les redirections.

Un site lent = un robot qui abandonne avant la fin. Résultat : page non indexée.

Étape 3 : L’Indexation (Stockage)

Google analyse le contenu de la page, la classe par thématique et décide si elle mérite d’être ajoutée à son index (sa base de données géante). Le Sitemap XML aide Google à découvrir toutes vos pages, même celles cachées dans votre arborescence ou mal liées.

Sans sitemap, Google peut ignorer 30% de vos pages les plus profondes.

Étape 4 : Le Ranking (Positionnement)

Une fois indexée, votre page peut enfin apparaître dans les résultats de recherche. Elle se positionne selon sa pertinence, son autorité et sa performance technique. C’est seulement à ce stade que vous pouvez générer des clics, du trafic et des leads.

La réalité : Si vos fichiers techniques bloquent les étapes 1, 2 ou 3, l’étape 4 n’arrive jamais. Vos efforts de contenu, de backlinks et de stratégie SEO sont gaspillés.

Le Fichier Robots.txt : Piloter votre Budget de Crawl Google

Le fichier robots.txt est un fichier texte brut situé à la racine de votre site (exemple : https://www.votresite.fr/robots.txt). Il donne des instructions aux robots des moteurs de recherche : quelles parties du site explorer, lesquelles ignorer.

Pourquoi c’est stratégique pour votre référencement

Google alloue à chaque site un budget de crawl : un temps limité d’exploration. Ce budget dépend de la taille de votre site, de son autorité et de sa fréquence de mise à jour. Si vous laissez Google perdre son temps sur des pages inutiles (recherche interne, panier, fichiers admin), il n’aura plus de ressources pour explorer vos pages stratégiques.

Impact business : Sur un site e-commerce de 10 000 produits, une mauvaise gestion du budget de crawl peut laisser 3 000 fiches produits non indexées pendant des semaines. Cela représente des milliers d’euros de ventes perdues chaque mois.

Configuration Robots.txt Recommandée par Traffic Makers

User-agent: * Disallow: /wp-admin/ Disallow: /wp-includes/ Disallow: /search/ Disallow: /panier/ Disallow: /mon-compte/ Disallow: /?s= Disallow: /*? Allow: /wp-admin/admin-ajax.php User-agent: GPTBot Allow: / User-agent: ChatGPT-User Allow: / Sitemap: https://www.votresite.fr/sitemap.xml

Explications ligne par ligne :

- • User-agent: * → S’applique à tous les robots (Google, Bing, etc.)

- • Disallow: /wp-admin/ → Bloque l’accès au tableau de bord WordPress

- • Disallow: /search/ → Bloque les pages de résultats de recherche interne (contenu dupliqué)

- • Disallow: /panier/ → Bloque les pages de panier (inutiles pour le SEO)

- • Disallow: /*? → Bloque les URLs avec paramètres (ex: ?utm_source=…)

- • Allow: /wp-admin/admin-ajax.php → Autorise les requêtes AJAX nécessaires au bon fonctionnement

- • User-agent: GPTBot → Autorise les robots d’OpenAI (important pour le GEO)

- • Sitemap: → Indique l’emplacement de votre sitemap XML

Les Erreurs de Syntaxe qui Cassent Tout

Le fichier robots.txt est sensible. Une faute de frappe peut bloquer l’accès à tout votre site.

Erreurs courantes :

- • Majuscule dans le nom de fichier : Le fichier doit s’appeler robots.txt, jamais Robots.txt ou ROBOTS.TXT.

- • Espace avant les commandes : Chaque ligne doit commencer sans espace.

- • Oublier le slash final : Disallow: /admin bloque /admin mais aussi /administration/.

Robots.txt vs Balise Noindex : Ne Pas Confondre

C’est l’erreur technique la plus fréquente que nous constatons lors de nos audits SEO.

Robots.txt empêche Google de visiter une page. Mais si des liens externes pointent vers cette page, Google peut quand même l’indexer (sans connaître son contenu).

Balise meta noindex empêche Google d’indexer une page, même s’il la visite.

Le piège : Si vous bloquez une page dans le robots.txt ET que vous ajoutez une balise noindex dans cette page, Google ne pourra jamais voir la balise noindex. La page restera potentiellement indexée.

La bonne méthode : Laissez l’accès libre dans le robots.txt, ajoutez la balise <meta name="robots" content="noindex, follow"> dans le <head> de la page. Google visitera la page, lira l’instruction noindex et la retirera de son index.

Le Sitemap XML : Votre Inventaire pour Google

Le sitemap XML est un fichier qui liste toutes les URLs importantes de votre site. Il aide Google à découvrir vos pages, comprendre leur structure et prioriser leur exploration. Pour les sites volumineux (e-commerce, portails de contenus, annuaires), c’est un outil indispensable.

Pourquoi Soumettre un Sitemap à Google Search Console

Google peut découvrir vos pages en suivant les liens internes. Mais cette méthode a des limites : Les pages orphelines ne seront jamais trouvées, les pages profondes peuvent être ignorées, et Google ne sait pas quelles pages sont prioritaires.

Le sitemap résout ces problèmes. Il dit explicitement à Google : « Voici toutes mes pages importantes, dans l’ordre de priorité. »

Optimiser votre Sitemap pour le GEO (Référencement IA)

Avec l’émergence du Generative Engine Optimization (GEO), les intelligences artificielles comme ChatGPT, Perplexity et Gemini ont besoin de données fraîches et structurées.

Un sitemap bien configuré avec des balises <lastmod> précises indique aux moteurs de recherche que votre contenu est régulièrement mis à jour. Cela favorise votre visibilité dans les réponses générées par les IA, qui privilégient les sources actualisées.

Recommandation Traffic Makers : Mettez à jour la balise <lastmod> chaque fois que vous modifiez substantiellement une page. Les IA et Google interpréteront cela comme un signal de fraîcheur.

Checklist : Votre Sitemap est-il Valide ?

- ✓ Toutes les URLs retournent un code HTTP 200 (pas de 404, 301 ou 500)

- ✓ Toutes les URLs sont en version canonique (HTTPS, avec ou sans www)

- ✓ Le fichier est accessible à l’adresse

/sitemap.xml - ✓ Le sitemap est déclaré dans votre fichier robots.txt

- ✓ Vous n’incluez pas d’URLs bloquées par le robots.txt ou en noindex

Le Fichier .htaccess : Contrôler Performance et Redirections

Le fichier .htaccess (Hypertext Access) est le fichier de configuration le plus puissant de votre site. Il agit directement au niveau du serveur Apache pour modifier le comportement de votre site avant même que les pages ne s’affichent.

Pourquoi la Vitesse de Chargement Impacte votre Référencement

Google utilise la vitesse comme critère de classement depuis 2010. Les chiffres qui comptent : 53% des utilisateurs mobiles abandonnent un site si le chargement dépasse 3 secondes. Le fichier .htaccess vous permet d’activer deux optimisations critiques : la compression Gzip et la mise en cache navigateur.

Gérer les Redirections 301 pour Préserver votre SEO

Lors d’une refonte, d’une migration HTTPS ou d’une restructuration d’URLs, les redirections 301 sont vitales. Elles transfèrent l’autorité SEO de vos anciennes pages vers les nouvelles. Une redirection 301 transfère environ 90-95% de cette autorité.

Forcer le HTTPS pour Sécuriser votre Site

Un site non sécurisé affiche un avertissement « Non sécurisé ». Google pénalise ces sites. Le .htaccess permet de forcer automatiquement tout le trafic vers la version sécurisée. Pour en savoir plus, consultez notre guide pour sécuriser votre site.

Checklist : Les Erreurs Critiques qui Tuent votre Référencement

- ! 1. Bloquer le CSS et le JavaScript dans Robots.txt : Google a besoin de les lire pour comprendre le rendu visuel.

- ! 2. Utiliser des URLs Relatives dans le Sitemap : Utilisez toujours des URLs absolues.

- ! 3. Créer des Boucles de Redirections : Testez chaque règle individuellement pour éviter l’erreur 500.

- ! 4. Oublier le Mobile-First : Vérifiez que votre configuration ne bloque pas les robots mobiles de Google.

- ! 5. Ne Pas Déclarer le Sitemap dans la Search Console : Soumettez-le manuellement pour forcer l’exploration.

Pourquoi Traffic Makers pour votre Optimisation Technique SEO

La configuration technique de votre site n’est pas un détail. C’est le socle de votre visibilité sur Google et sur les intelligences artificielles. Chez Traffic Makers, agence d’acquisition digitale à Boulogne-Billancourt, nous analysons ces fichiers critiques lors de chaque audit.

Votre Site est-il Techniquement Prêt pour 2026 ? Ne laissez pas des fichiers invisibles brider votre croissance. Un site bien configuré génère 40% de trafic organique supplémentaire en moyenne.

Demander mon Audit Technique Gratuit

Profitez d’un audit technique gratuit réalisé par nos consultants SEO seniors. Nous analysons votre robots.txt, votre sitemap et votre vitesse.

FAQ : Configuration Technique SEO

La configuration technique soulève souvent de nombreuses interrogations stratégiques. Nos experts ont regroupé ici les questions les plus fréquentes pour vous aider à comprendre l’impact business de ces optimisations invisibles.

Qu'est-ce que le SEO technique et pourquoi est-il essentiel ?

Le SEO technique désigne l’ensemble des optimisations de l’infrastructure d’un site web visant à faciliter son exploration (crawl) et son indexation par les moteurs de recherche. C’est le socle de votre visibilité : si Googlebot ne peut pas accéder à votre contenu à cause d’erreurs techniques, même le meilleur texte du monde ne sera jamais classé. Optimiser le SEO technique, c’est s’assurer que votre « maison digitale » est saine et accueillante pour les robots.

Comment fonctionne réellement l'algorithme de Google ?

L’algorithme de Google est un système complexe qui classe les pages web selon des centaines de critères (pertinence, autorité, expérience utilisateur). Son fonctionnement suit trois étapes : le Crawl (découverte de la page), l’Indexation (compréhension et stockage) et le Ranking (affichage selon le score de pertinence). En 2026, Google privilégie les sites rapides, sécurisés et dont le contenu répond précisément à l’intention de recherche de l’utilisateur.

Pourquoi mon site web ne convertit-il pas malgré un bon trafic SEO ?

Le SEO amène les visiteurs, mais c’est l’expérience utilisateur (UX) et le CRO (Conversion Rate Optimization) qui transforment. Si votre site ne convertit pas, le problème peut être technique (site trop lent, erreurs sur mobile), sémantique (vous attirez le mauvais public avec des mots-clés inadaptés) ou ergonomique (absence de boutons d’action clairs). Un bon SEO doit toujours être couplé à une stratégie business orientée vers l’utilisateur.

Quels sont les éléments les plus importants du SEO technique ?

Les priorités absolues sont : la vitesse de chargement (Core Web Vitals), l’adaptabilité mobile (Mobile-First), la sécurité (HTTPS), la gestion du budget de crawl (Robots.txt) et la clarté de l’architecture (Sitemap XML et structure d’URLs). Sans ces piliers, votre référencement organique restera plafonné.

Quelle est la différence entre un sitemap HTML et un sitemap XML ?

Le sitemap HTML est une page web lisible par vos visiteurs pour les aider à naviguer. Le sitemap XML est un fichier caché, strictement destiné aux robots de Google pour lister techniquement vos URLs prioritaires. Recommandation Traffic Makers : Il est indispensable de posséder les deux pour satisfaire à la fois les humains et les algorithmes.

Quelles sont les erreurs courantes de la Google Search Console à surveiller ?

Les alertes les plus critiques concernent les erreurs de couverture (pages bloquées par le robots.txt alors qu’elles devraient être indexées), les erreurs de redirection, les problèmes d’ergonomie mobile et les erreurs 404 intempestives. Ignorer ces notifications, c’est laisser votre site se dégrader aux yeux de Google.

Combien de temps après la soumission du sitemap mes pages sont-elles indexées ?

Ce délai varie selon l’autorité de votre domaine. Pour un site leader très fréquenté, cela peut prendre quelques heures. Pour un site récent ou moins « puissant », le délai moyen constaté se situe entre 1 et 4 semaines. Soumettre manuellement via la Search Console reste le meilleur moyen d’accélérer ce processus.